はじめに

楽天は3月17日、国産の大規模 AI モデル「Rakuten AI 3.0」の提供を開始しました。

本モデルは、経済産業省および NEDO が主導する「GENIAC プロジェクト」の一環として開発され、約7000億パラメータという国内有数の規模を誇ります。日本語に最適化されたアーキテクチャを採用し、主要なベンチマークで高いスコアを記録するなど、国内の AI 開発において重要なマイルストーンとなるモデルです。

本記事では、Rakuten AI 3.0 の概要と技術的な特徴、他の主要モデルとの違い、そして想定されるビジネスでの活用シナリオについて解説します。

- Rakuten AI 3.0 の概要と MoE アーキテクチャの特徴

- 日本語ベンチマークにおけるスコアと他モデルとの違い

- 実務での活用シナリオとオープンソース(Apache 2.0)公開の意義

Rakuten AI 3.0 の概要と技術的背景

Rakuten AI 3.0 は、日本の言語や文化、歴史的背景の理解に特化して開発された大規模言語モデル(LLM)です。その最大の特徴は、膨大なパラメータ数と最新の推論アーキテクチャの採用にあります。

7000億パラメータと「MoE(Mixture of Experts)」アーキテクチャの採用

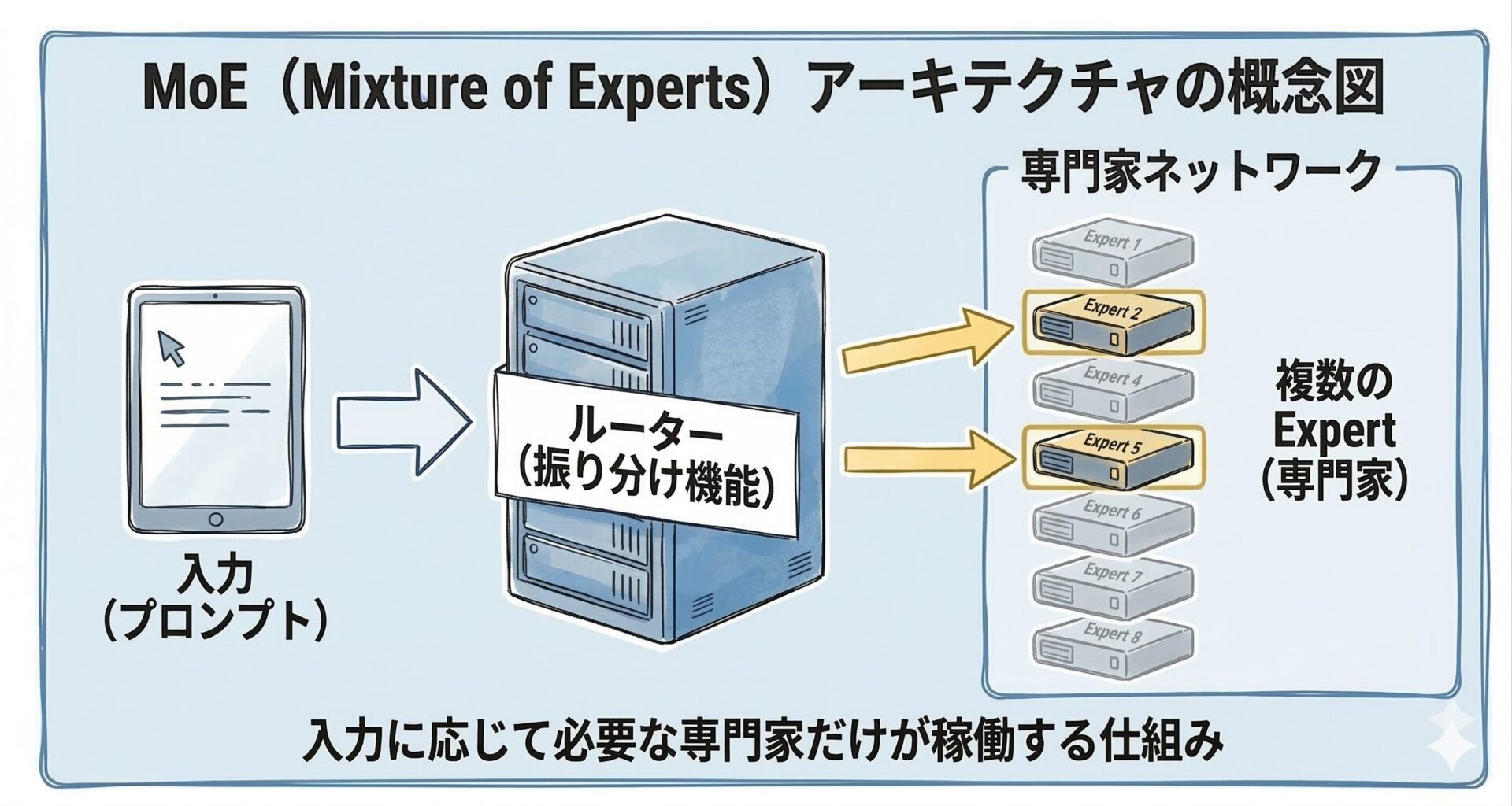

本モデルは、約7000億という非常に大規模なパラメータを持っています。この規模のモデルを実用的な速度で効率的に動作させるため、「MoE(Mixture of Experts)」と呼ばれるアーキテクチャが採用されています。

MoE は、モデル内部に複数の「専門家(Expert)」ネットワークを配置し、入力された文章(タスク)の性質に応じて、必要な専門家ネットワークのみを部分的に稼働させる仕組みです。これにより、計算リソースの消費を抑えながら、高度な推論能力と高速な処理を両立しています。

経産省・NEDO 主導「GENIAC プロジェクト」における開発の背景

開発は、経済産業省および NEDO(新エネルギー・産業技術総合開発機構)が主導する生成 AI 開発支援プログラム「GENIAC プロジェクト」の一環として行われました。

国内の AI 開発基盤の強化と競争力向上を目的とした同プロジェクトの支援を受け、楽天は大規模な計算資源と独自のデータ処理技術を活用し、日本語処理においてトップクラスの性能を持つ AI モデルを完成させました。

他の主要 AI モデルとの違いと市場での立ち位置

海外製のグローバルな LLM が多数存在する中で、Rakuten AI 3.0 は「日本語」という特定の言語圏において独自の立ち位置を確立しています。また同じ国産 AI モデルと比較しても明確なアプローチの違いがあります。

国産軽量モデル(NTT「tsuzumi」等)とのアプローチの違い

国内企業による LLM 開発としては、NTT が提供する「tsuzumi」シリーズなども注目されています。tsuzumi が「1GPU で動作する軽量さ」と「オンプレミス環境でのセキュアな運用」に特化しているのに対し、Rakuten AI 3.0は「7000億パラメータという圧倒的な規模」と「オープンソースでの無償公開」を強みとしています。

つまり、機密情報を扱う特定の業務に特化させて低コストで運用したい場合は tsuzumi のような軽量モデルが適していますが、より複雑で高度な推論能力や、大規模な基盤モデルとしての汎用性を求める場合には Rakuten AI 3.0 が強力な選択肢となります。

日本独自の文化・歴史・文脈理解への最適化

グローバルモデルの多くは英語ベースの学習データが中心であり、日本語特有の敬語のニュアンスや、日本固有の文化・歴史的背景の理解に課題を残すケースがあります。Rakuten AI 3.0 は、開発段階から日本語の文脈理解に最適化されており、より自然で日本のビジネス習慣に即した回答の生成に強みを持っています。

日本語ベンチマークでの高いスコアと強み

Rakuten AI 3.0 は、日本固有の文化・歴史知識や大学院レベルの推論などを測る複数の日本語ベンチマークテストにおいて、OpenAI の「gpt-4o」や国内の主要なオープンモデルを上回るスコアを記録しています。

| モデル名 | JamC-QA1 | MMLU-ProX2 | MATH-1003 | M-IFEval4 |

| Rakuten AI 3.0 | 76.9 | 71.7 | 86.9 | 72.1 |

| gpt-4o | 74.7 | 64.9 | 75.8 | 67.3 |

| GPT-OSS-Swallow-120B-RL-v0.1 | 63.0 | 63.0 | 70.5 | 69.5 |

| Stockmark-2-100B-Instruct | 61.1 | 41.7 | 55.6 | 45.6 |

| ABEJA-QwQ32b-Reasoning-v1.0 | 61.1 | 61.1 | 52.7 | 61.9 |

実務における活用シナリオと今後の期待

Rakuten AI 3.0 は、その高い日本語処理能力を活かし、様々なビジネスシーンへの導入が期待されています。

文章作成、コード生成、文書解析への応用

自然な日本語での「文章作成」はもちろんのこと、システム開発における「コード生成」、および膨大な社内ドキュメントやマニュアルを読み解く「文書解析」など、幅広い用途で利用可能です。高い文脈理解能力により、要約作業や翻訳、社内向けチャットボットの精度向上が見込めます。

Apache 2.0 ライセンスによる国内 AI 開発への貢献

本モデルは、AI プラットフォーム「Hugging Face」の公式リポジトリにて、商用利用が可能な「Apache License 2.0」のもとで無償公開されています。

これにより、国内の企業や研究機関はライセンスの制約を気にすることなく、自社のデータを用いてファインチューニング(追加学習)を行い、独自のシステムに組み込むことが可能です。楽天の継続的な研究開発推進により、国内 AI 技術の普及とコラボレーションがさらに加速することが期待されます。

まとめ

本本記事では、楽天が提供を開始した大規模 AI モデル「Rakuten AI 3.0」の概要と特徴について解説しました。

- GENIAC プロジェクトの一環で開発された、約7000億パラメータの国産AIモデルである。

- MoE アーキテクチャの採用により、高い処理効率と推論能力を両立している。

- 軽量特化型の国産 AI(tsuzumi 等)とは異なり、汎用性と規模の大きさを強みとする。

- 日本語ベンチマークで高スコアを記録し、Apache 2.0 ライセンスで商用利用が可能である。

以上、最後までお読みいただきありがとうございました。