はじめに

近年、AI 開発においてローカル環境でのモデル実行が注目を集めています。その中で、2026年4月に Google の最新軽量モデルである Gemma 4 が Docker Hub に公式対応しました。

Gemma 4 が Docker Hub に対応した背景には、AI モデルをコンテナアーティファクトとして扱い、バージョン管理や共有、デプロイをより容易にするという目的があります。これにより、開発者は専用のツールチェーンを用意することなく、使い慣れた Docker のワークフローをそのままAI領域でも活用することが推奨されます。

参考: Docker 公式ブログ(Gemma 4 is Here: Now Available on Docker Hub)

“By packaging models as OCI artifacts, models behave just like containers. They become versioned, shareable, and instantly deployable, with no custom toolchains required.”

(モデルを OCI アーティファクトとしてパッケージ化することで、モデルはコンテナとまったく同じように振る舞います。これらはバージョン管理、共有、即時デプロイが可能になり、カスタムツールチェーンは必要ありません。)

https://www.docker.com/blog/gemma4-dockerhub/

しかし、リリース直後の現時点では、ローカルの Docker 環境に Gemma 4 を引き込もうとすると、システムの対応状況に起因するエラーが発生するケースが確認されています。本記事では、そのエラーの根本的な原因を解説するとともに、現時点ですぐに利用可能な代替策(Gemma 3)の導入手順を紹介します。

これから Docker 環境を構築される方は、以下の記事も参考にしてください。

- Docker Hub に Gemma 4 を導入するメリット

- 導入時に発生するエラー(unknown model architecture)の具体的な原因

- 現時点での確実な代替策(Gemma 3)のローカル構築手順

- アプリケーション連携時の API 有効化手順

- 今後の対応状況を確認するための情報源

お時間がない方向けに、 2 分の音声で要点をサクッと解説しています。

※解説はブログ記事をもとに AI で生成しています。

Docker Hub に Gemma 4 を導入するメリットとローカル環境との違い

従来のローカル環境における AI モデルの構築では、Python 環境の整備や専用の推論ツール(llama.cppなど)のコンパイル、Hugging Face 等からの手動でのファイルダウンロードなど、複数のステップを踏むことが一般的でした。また、依存関係の競合やツールチェーンの管理が複雑になる傾向がありました。

これに対して、Docker Hub を活用して Gemma 4 などのモデルを導入する場合、最大のメリットは「モデルをコンテナと同じように扱える点」にあります。専用の認証手順やダウンローダーを別途用意することなく、アプリケーション開発で慣れ親しんだ Docker コマンドのみで完結するため、環境構築のハードルが大きく下がります。

また、チーム開発や別サーバーへの移行を行う際も、コンテナイメージと同様に共有・バージョン管理が行えるため、環境の差異による動作不良の防止につながります。したがって、CI/CDパイプラインへの組み込みやエッジデバイスへの展開を見据える場合、Docker 経由での導入を推奨します。

Gemma 4 導入時に発生するエラーと原因(unknown model architecture)

公式の手順通りに docker model pull gemma4 を実行し、モデルのダウンロードが完了したにもかかわらず、実行時に unknown model architecture: 'gemma4' や failed to load model というエラーが発生し、コンテナが強制終了するケースがあります。このエラーの主な原因は以下の3点に分類されます。

Docker Desktop のモデル実行機能(Docker Model Runner)の裏側では、llama.cpp などの推論エンジンが稼働しています。Gemma 4 は新しいアーキテクチャを採用しているため、現行バージョンの推論エンジンがその構造を解釈できず、エラーを出力します。公式ブログでも言及されている通り、ランナー側の正式な対応にはアップデートを待つ必要があります。

参考: Docker 公式ブログ(Gemma 4 is Here: Now Available on Docker Hub)

“Over the next few weeks, Gemma 4 support is coming to Docker Model Runner, so you will not just discover models on Hub, you will be able to run, manage, and deploy them directly from Docker Desktop”

(今後数週間のうちに、Gemma 4 のサポートが Docker Model Runner に追加される予定です。これにより、Hubでモデルを発見するだけでなく、Docker Desktop から直接実行、管理、デプロイできるようになります。)

https://www.docker.com/blog/gemma4-dockerhub/

Gemma 4 には複数のサイズが存在します。例えば、26B や 31B などのパラメータ数が多いモデルは、実行時に 15 GB から 20 GB 以上のメモリを消費します。一般的なローカル環境(例: メインメモリ 16 GB、VRAM 4 GB 程度)でこれらを読み込んだ場合、アーキテクチャの対応可否にかかわらず、メモリ容量の限界によりシステムがクラッシュする原因となります。

Hugging Face 等から取得できるモデルの中には、バックエンドとして vllm を要求するものがあります。vLLM は推論を高速化する強力なエンジンですが、大容量の VRAM と高性能な GPU 環境を前提としています。リソースが限られた環境では起動に失敗するため、自身の環境に合わせて llama.cpp 対応かつ GGUF 形式のモデルを選択することを推奨します。

現時点での代替案(Gemma 3 導入手順)

Gemma 4 の対応が完了するまでの間は、すでにアーキテクチャが対応済みで安定稼働する Gemma 3 の利用を推奨します。

Docker Hub には様々な生成 AI モデルがホストされており、Gemma 3 であれば現行の llama.cpp エンジンでも問題なく読み込むことが可能です。

Gemma 3 は、メモリ 16 GB 程度のローカル PC 環境でも CPU リソースを活用して十分なパフォーマンスを発揮します。導入は以下の2つのコマンドのみで完了します。

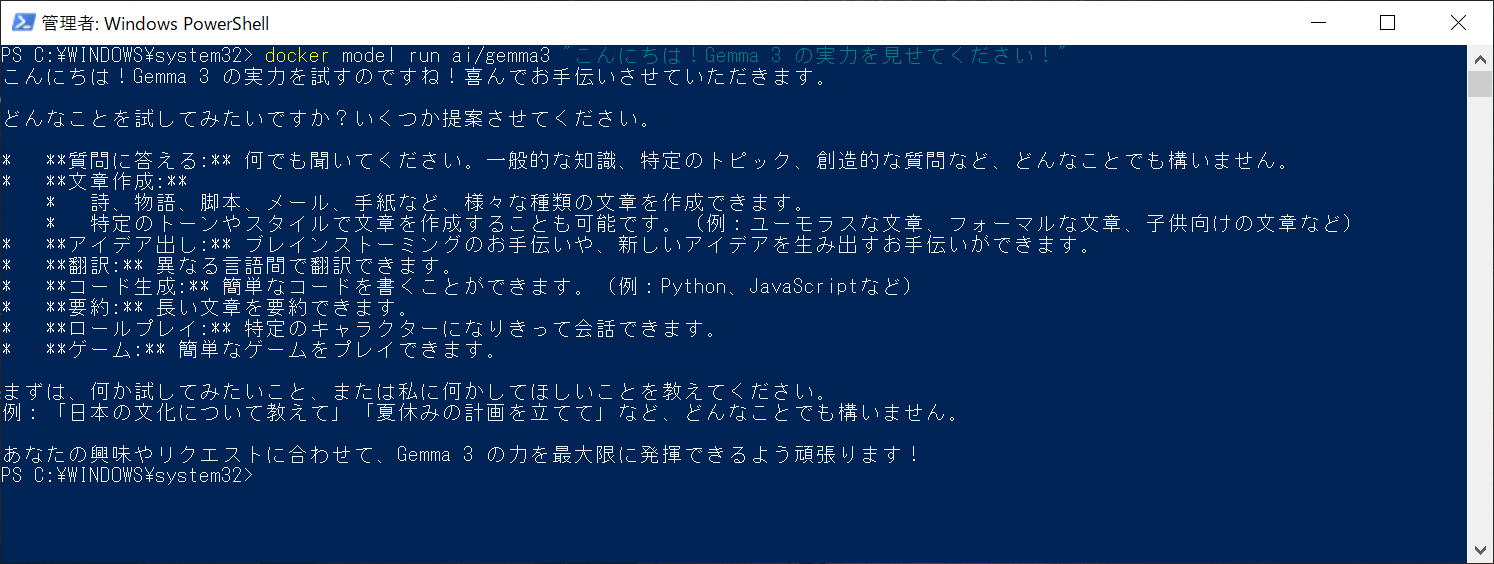

まずは、以下のコマンドで Gemma 3 のイメージを取得します。

docker model pull ai/gemma3ダウンロード完了後、以下のコマンドでコンテナを起動し、プロンプトを送信して対話を開始します。

docker model run ai/gemma3 "こんにちは!Gemma 3 の実力を見せてください!"

Gemma 3 を用いた簡単なアプリケーション連携例

Docker 環境に構築した Gemma 3 は、ターミナル上での対話だけでなく、外部のアプリケーションから API 経由で呼び出すことも可能です。これにより、独自の Web アプリケーションや社内ツールに生成 AI の機能を容易に組み込むことができます。

Docker のモデルコンテナは、標準的なインターフェースを提供しているため、既存のツールチェーンやライブラリをそのまま活用することが推奨されます。

参考: Docker 公式ブログ(Gemma 4 is Here: Now Available on Docker Hub)

“You can pull ready-to-run models from Docker Hub, push your own, integrate with any OCI registry, and plug everything directly into your existing CI/CD pipelines using familiar tooling for security, access control, and automation.”

(すぐに実行できるモデルを Docker Hub からプルしたり、独自のモデルをプッシュしたり、任意のOCIレジストリと統合したり、セキュリティ、アクセス制御、自動化のための使い慣れたツールを使用して既存のCI/CDパイプラインにすべてを直接組み込むことができます。)

https://www.docker.com/blog/gemma4-dockerhub/

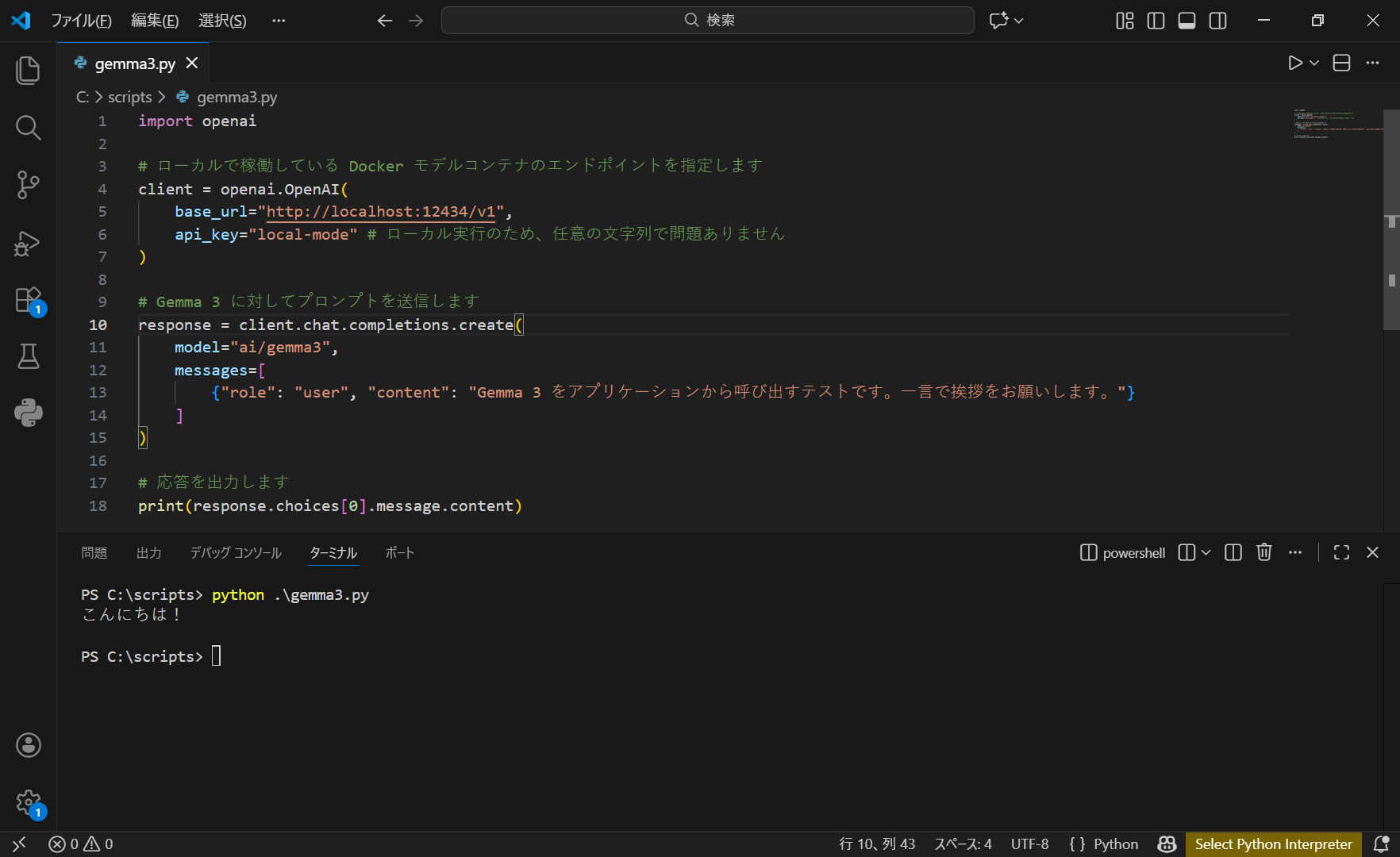

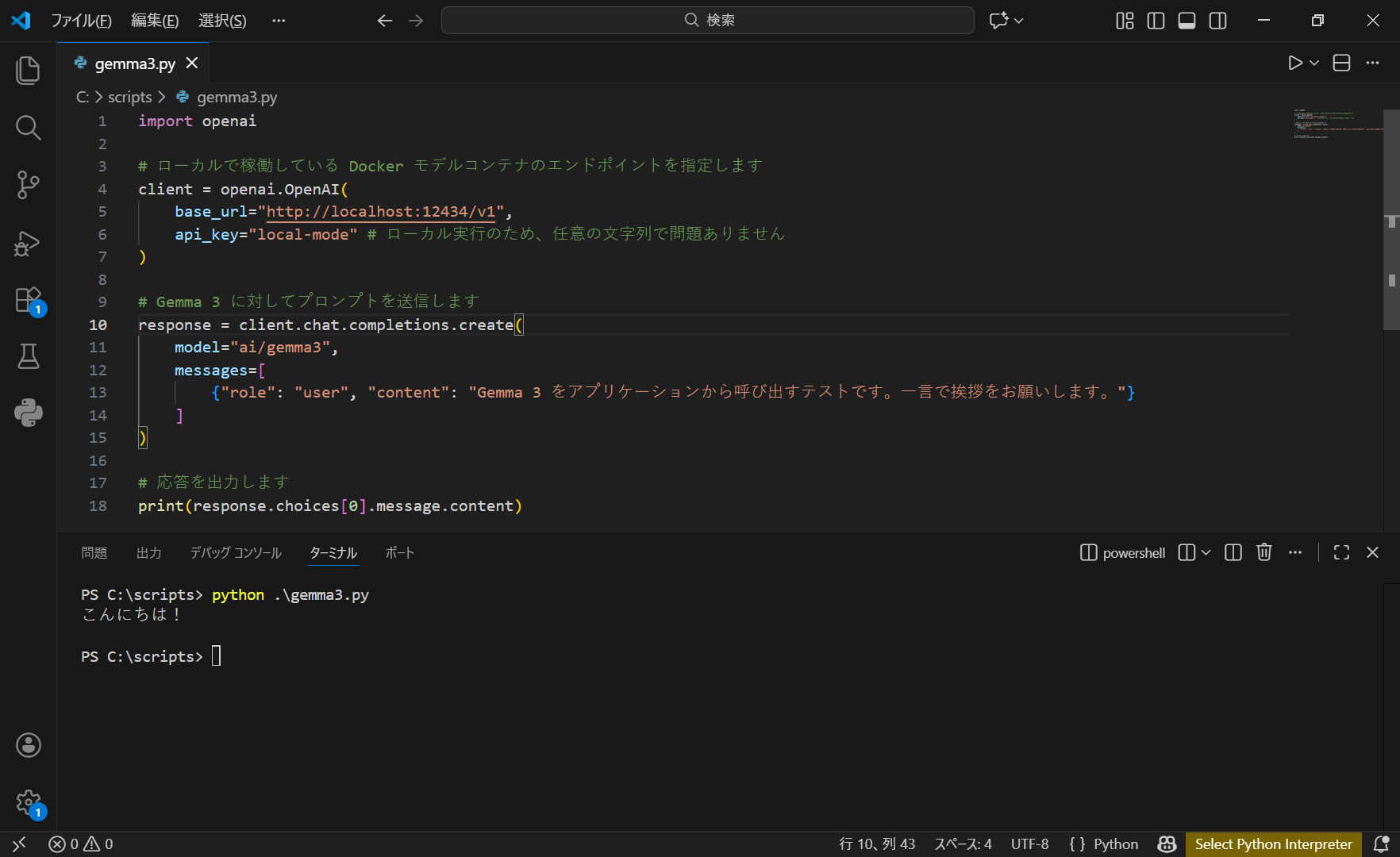

ここでは、Python と OpenAI の公式ライブラリ(openai)を使用して、ローカルで稼働している Gemma 3 にリクエストを送信する簡単な連携スクリプトの例を紹介します。

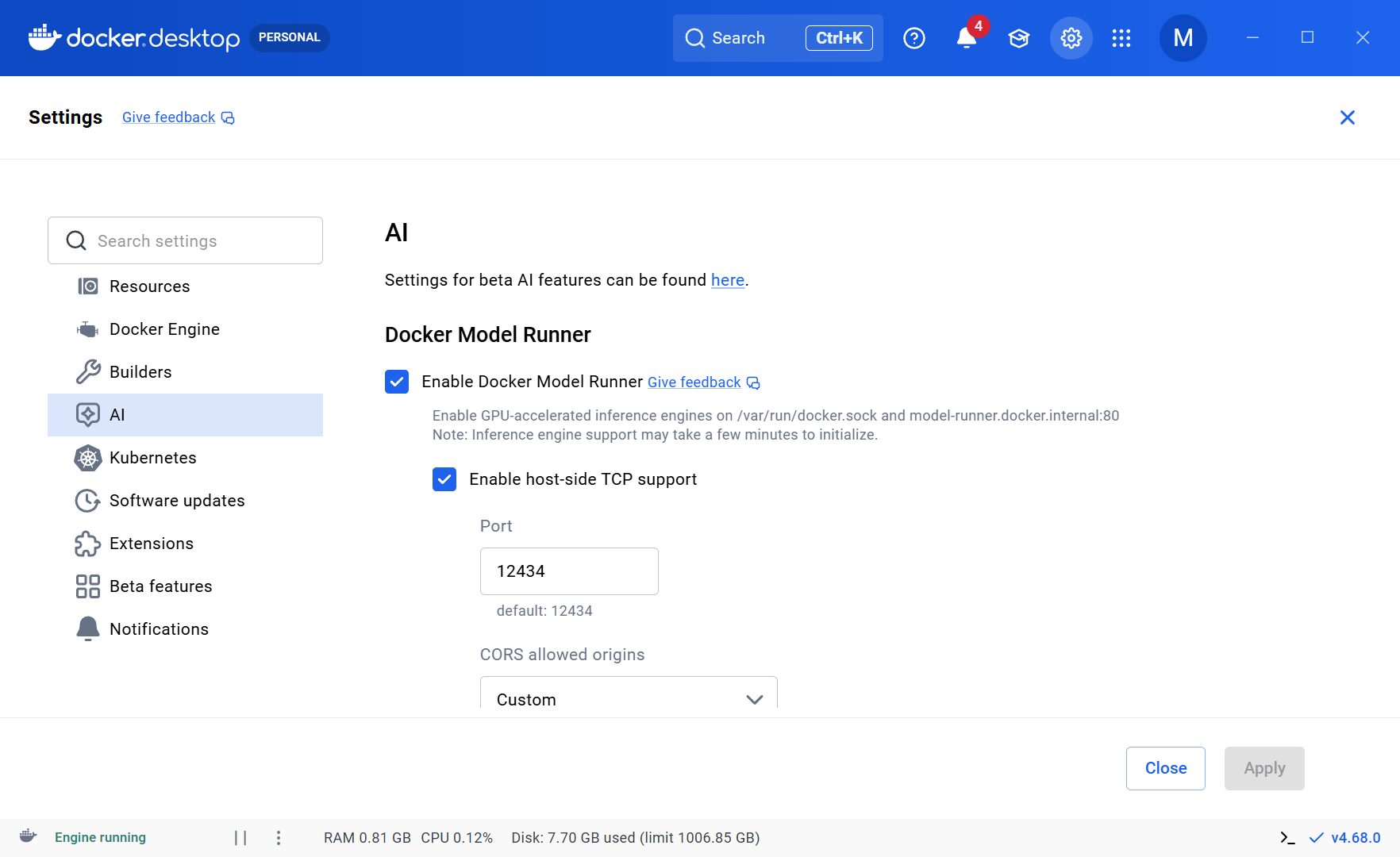

事前設定: Docker Desktop での API(TCP サポート)有効化

最新の Docker Model Runner は、外部からリクエストを受けたタイミングで自動的にモデルを起動する「オンデマンド仕様」を採用しています。そのため、手動でサーバー化するコマンド(serve など)は不要ですが、セキュリティの観点から初期状態では外部アクセスがブロックされています。

アプリケーションと連携する前に、以下の手順で TCP サポートを有効にしておくことを推奨します。

- Docker Desktop を開き、右上の歯車アイコン(Settings)を選択します。

- 左側のメニューから「Features in development」(環境によっては「AI」タブ)を開きます。

- 「Enable host-side TCP support」にチェックを入れます。(ここでポート番号が 12434 に設定されていることが確認できます)

- 「Apply & restart」をクリックし、Docker Desktop を再起動します。

Windows 環境への Python の導入手順については、以下の記事も参考にしてください。

※記事内では Python 3.7 を例としていますが、基本的なインストール手順は最新バージョンでも同様に適用可能です。

連携スクリプトの例(Python)

ローカルの Docker Model Runner は、通常ポート 12434 (または環境に応じたポート)でリクエストを受け付けます。以下のコードは、そのローカルエンドポイントに向けてメッセージを送信する仕組みです。

import openai

# ローカルで稼働している Docker モデルコンテナのエンドポイントを指定します

client = openai.OpenAI(

base_url="http://localhost:12434/v1",

api_key="local-mode" # ローカル実行のため、任意の文字列で問題ありません

)

# Gemma 3 に対してプロンプトを送信します

response = client.chat.completions.create(

model="ai/gemma3",

messages=[

{"role": "user", "content": "Gemma 3 をアプリケーションから呼び出すテストです。一言で挨拶をお願いします。"}

]

)

# 応答を出力します

print(response.choices[0].message.content)このスクリプトを実行すると、インターネットを経由することなく、PC 内の CPU とメモリのみを使用して Gemma 3 が回答を生成します。

このように、Docker でAIモデルをコンテナ化しておくことで、開発環境と本番環境の差異を意識することなく、シームレスなアプリケーション開発が可能になります。

今後の対応時期と情報源

現在発生している Gemma 4 のアーキテクチャ未対応に関するエラーについては、公式側も開発を進めており、近日中のアップデートで正式にサポートされる見込みです。

参考: Docker公式ブログ(Gemma 4 is Here: Now Available on Docker Hub)

“And this is just the start. Over the next few weeks, Gemma 4 support is coming to Docker Model Runner”

(そして、これはほんの始まりに過ぎません。今後数週間のうちに、Gemma 4 のサポートが Docker Model Runner に追加される予定です)

https://www.docker.com/blog/gemma4-dockerhub/

もし、興味がある方は、以下の情報源を定期的にチェックしてみてください。

- Docker 公式ブログ

-

新機能のリリースや、モデルランナーの大型アップデートに関する公式アナウンスが掲載されます。

- Docker Model Runner の GitHub リポジトリ

-

Issue やリリースノートを確認することで、具体的なエンジンの対応バージョンやバグ修正の進捗をリアルタイムで把握できます。

まとめ

- Docker Hub を活用することで、AI モデルをコンテナとして管理でき環境構築のハードルが下がる。

- Gemma 4 導入時のエラーは、推論エンジンのアーキテクチャ未対応やリソース不足が主な原因

- 正式対応が完了するまでは、安定稼働する Gemma 3 を代替として導入することを推奨する。

- Docker 経由で構築した AI モデルは、API を通じて外部アプリケーションとも連携できる。

- 最新の対応状況は、公式ブログや GitHub リポジトリから定期的に情報を収集すること推奨

以上、最後までお読みいただきありがとうございました。